我中心研究员及学生在机器学习顶级会议发表论文

2023-06-12

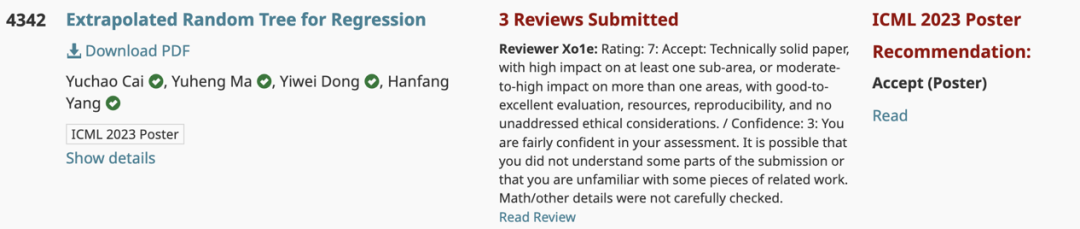

我中心研究员杨翰方教授与学生蔡宇超、马宇恒、董奕玮在ICML 2023发表论文,提出了一种新的回归树模型,在任意光滑的函数空间里,该模型的收敛速度达到了极小极大最优。同时,模型的实验效果优于现有最先进的回归树模型。

论文题目

Extrapolated Random Tree for Regression

文章摘要

在这篇论文中,我们提出了外推随机回归树,它能够适应任意阶光滑的回归函数,同时保持树的可解释性。首先,我们提出了位似随机回归树,当位似比(homothetic ratio)趋近于零时,它收敛于目标函数。外推随机回归树利用线性回归将在不同位似比下的估计值外推到位似比为零。从理论的角度,在任意光滑的目标函数空间里,我们得到了外推随机回归树的收敛速度上界,该上界达到了极小极大收敛速度。同时,随机回归树在这些空间中的收敛速度下界严格慢于该上界。这表明在高阶光滑的目标函数上,外推的方法使得树模型的理论性质得到提升。在实验中,我们将外推随机回归树与现有最先进的树算法在真实数据集上进行了比较,结果显示外推随机回归树的性能优于其他方法。此外,通过将外推树作为基学习器应用于集成方法,我们取得了更好的实验效果。

作者介绍

蔡宇超(共同第一作者),统计学院2018级博士研究生。

马宇恒(共同第一作者),统计学院2021级博士研究生。

董奕玮,统计学院2022级硕士研究生。

杨翰方(通讯作者),中国人民大学统计学院教授,应用统计科学研究中心研究员。

会议介绍

国际机器学习会议(International Conference on Machine Learning,简称ICML)在世界范围内每年召开一次,是机器学习/人工智能领域的顶级会议。

论文发表截图