“统计大讲堂”第205讲回顾:无监督多任务中的高斯混合模型迁移学习

2023-03-10

1月5日下午,“统计大讲堂”系列讲座第205讲举行。本次讲座采取线上会议的方式,邀请纽约大学生物统计学系副教授冯阳作题为“无监督多任务中的高斯混合模型迁移学习”的报告。讲座由中国人民大学统计学院教授王星主持。百余师生参加此次讲座。

王星首先介绍了主讲人的相关信息。冯阳是纽约大学生物统计学系副教授,于2010年获得普林斯顿大学运筹学博士学位。研究兴趣包括机器学习、高维数据、社交网络、非参数统计和生物信息学,在统计学和机器学习领域的知名期刊上发表了50余篇文章。目前担任the Journal of the American Statistical Association,Journal of Business and Economic Statistics,Statistica Sinica和Stat的副主编,是美国统计协会的会员和国际统计学会的当选成员。

首先,冯阳通过垃圾邮件识别的例子引入多任务学习和迁移学习并比较二者目标的区别。然后冯阳指出目前学界侧重于研究有监督学习,现有的少量无监督学习研究缺乏理论结果,从而阐明使用GMM模型研究无监督学习和迁移学习的重要意义。

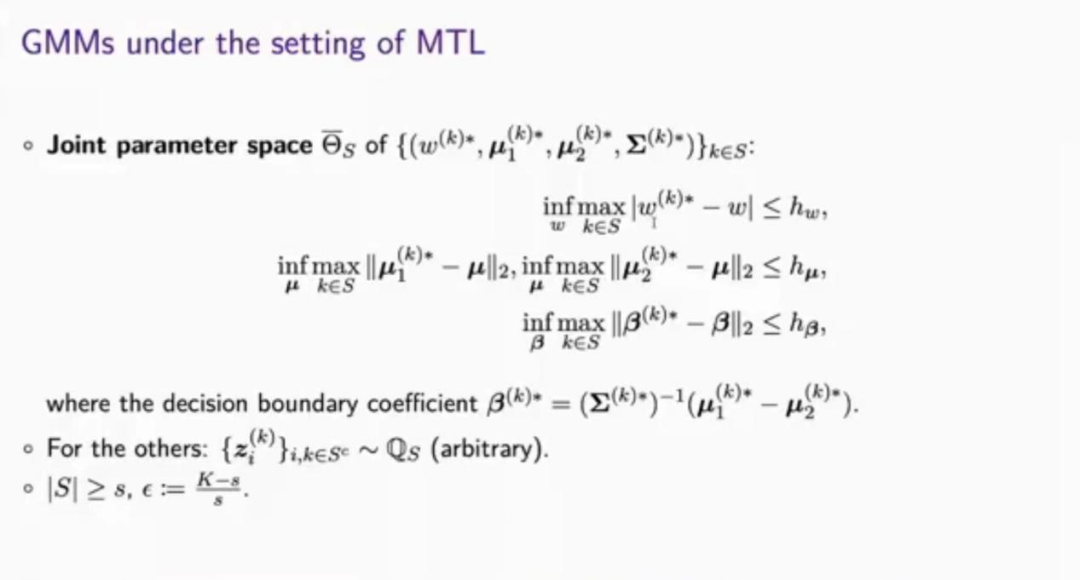

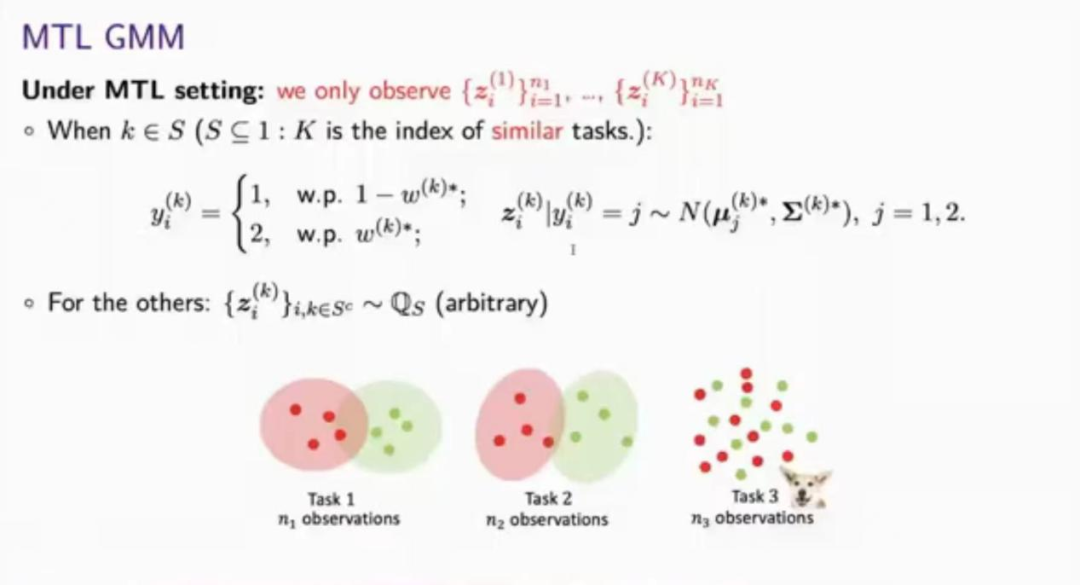

接着,冯阳先回顾单任务高斯混合模型的原理和经典的EM算法的流程。然后引入新设定,介绍多任务学习的高斯混合模型。冯阳假设存在K个任务,同时设定相似任务的集合为S,各任务间的相似性用三个不同的参数去度量。

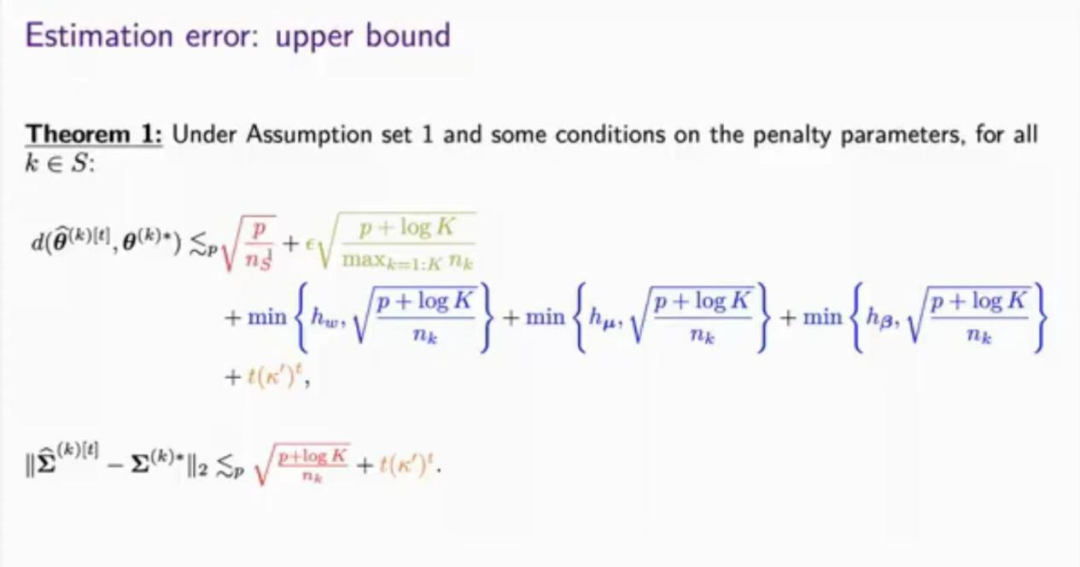

之后,冯阳阐述算法的思路和具体步骤。冯阳在原模型中加入惩罚项并详细说明其关键作用。然后冯阳设定了一系列假设。在此基础之上,冯阳得出参数和分类误差的上下界并依据结果的形式作出解释。冯阳强调,任务的编码改变之后直接套用算法会导致结果出现错误。因此他设置score函数来衡量分类错误,反复交换编码直至函数值达到最小,保证了结果的稳健性。

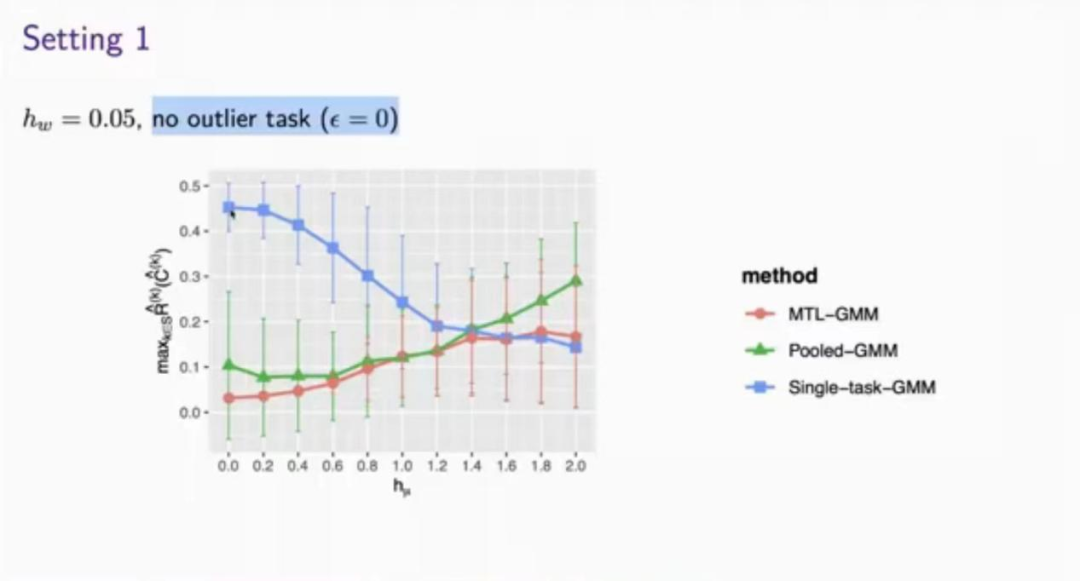

模拟实验后,冯阳得出相应结果。在不同hw值和异常任务数量的情形下,冯阳对比分析单任务GMM、Poooled-GMM和多任务学习GMM三种算法的结果图,发现新算法结合了前两者的优点,具有良好的稳定性。

最后冯阳对此次报告做总结,指出未来工作的方向是将算法扩展到多个类别、协方差不同的情形。

在提问环节中,冯阳认真细致地回答了师生们关于算法细节步骤的疑问,与师生就本话题进行了更深入的探讨。