“统计大讲堂”系列讲座第一百零一讲

2019-11-07

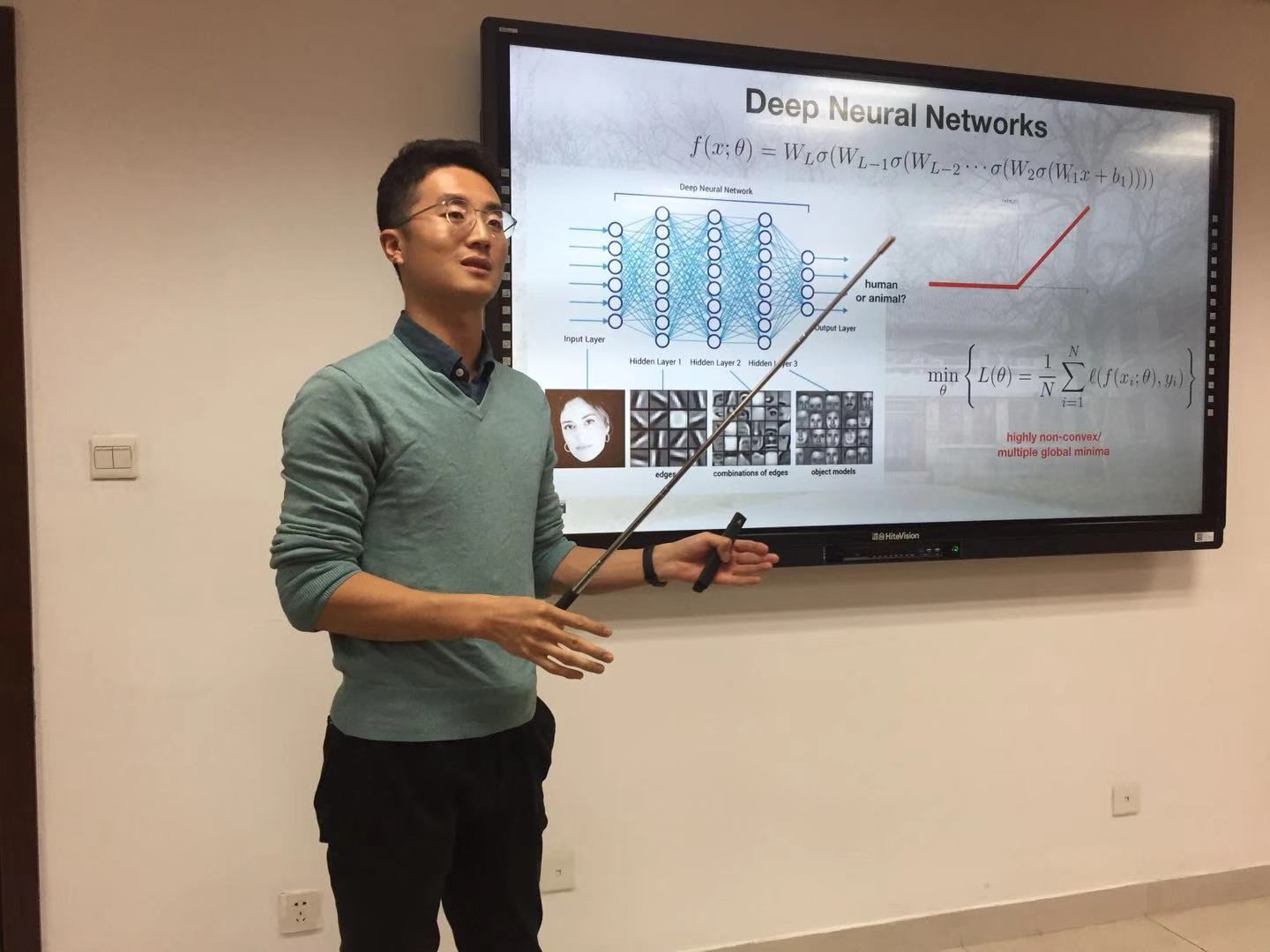

2019年11月6日,“统计大讲堂”系列讲座第一百零一讲在明德主楼1016会议室顺利举行。本次讲座邀请了北京大学朱占星老师分享了他与学生的最新研究成果。我院孙怡帆副教授主持了本次讲座。

孙怡帆副教授首先介绍了报告人。

朱占兴,于2016年在爱丁堡大学获得机器学习博士学位,现任北京大学数学科学学院助理教授,并在北京大学数据科学中心从事科研工作。研究方向包括机器学习及其在各个领域的应用;目前主要专注于深度学习理论、优化算法、强化学习及其在交通、计算机安全、计算机图形学、医疗和保健等领域的应用;在人工智能顶级期刊和会议(例如NIPS,ICML,CVPR,ACL,IJCAI,AAAI,ECML等)上发表了40多篇论文;曾获得“2019年阿里巴巴达摩院青橙奖”、顶级计算机安全会议CCS2018“最佳论文入围奖”。

朱占星老师的报告题目是:Adversarial Training for Deep Learning: A Framework for Improving Robustness and Generalization。朱占星老师首先从深度学习在计算机视觉、自然语言处理,甚至游戏对弈等领域取得的巨大成功开始讲起,接着简要介绍了深度神经网络的数学模型,以及深度学习理论的最新研究方向,然后引入了这次讲座的重点:“稳健性:对抗样本及其防御机制”。

最近的研究表明,人们可以通过操纵输入的微小变化来欺骗深度学习模型,以产生错误的预测。被操纵的样本称为对抗示例,这种行为称为对抗攻击。他首先以图像识别为例,展示了对抗攻击的多种类型,说明了目前深度学习系统的弱稳健性。接着介绍了构建对抗示例的方法,并解释了对抗示例的迁移性。然后着重讲解了名为对抗学习的框架,该框架用于提高深度神经网络的稳健性来防御对抗示例。他还从最佳控制理论的角度提出了两种加快对抗训练的方法;也展示了对抗学习框架可以作为一种有效的正则化策略进行扩展,以改善半监督学习的泛化性。最后,朱占星老师对本次讲座的内容作了总结,并介绍了一些其他正在进行的相关工作。

讲座结束后,在场师生与朱占兴老师就关于对抗训练的泛化性、深度学习的可解释性、迁移学习等问题进行了热烈讨论。